説明可能なAI(XAI)とは?

説明可能なAI(XAI)とは?

説明可能なAIは、AIの機械学習(ML)アルゴリズムによって作成された結果と出力をユーザーが理解し、信頼できるようにする一連のプロセスと方法です。AI/ML出力に 説明は、ユーザー、事業者、または開発者に向けたもので、ユーザーによる導入からガバナンス、システム開発にいたるまでの懸念事項や課題に対処することを意図したものです。この「説明可能性」は、AIが市場で必要とされる信頼と信用を得て、AIが幅広く導入されてそのメリットが推進されるための中核をなします。その他の関連する取り組みや、新しい取り組みには、信頼されるAIと責任あるAIがあります。

説明可能なAIの実装方法とは?

米国国立標準技術研究所(NIST:National Institute of Standards and Technology)は、4つの原則がXAIを推進していると述べています。

- 説明:システムから、すべての出力に付随する証拠または理由が提供されます。

- 意義:システムから、個々のユーザーが理解できる説明が提供されます。

- 説明の精度:説明が、出力を生成するシステムのプロセスを正しく反映しています。

- 知識の限界:システムは、設計された条件下、または、その出力が十分な信頼水準を達成した場合のみ動作します。

NISTは、説明には単純なものから複雑なものまであり、その消費者によって異なると述べています。NISTは、以下の5つのサンプル説明能力カテゴリー(全カテゴリーではありません)を使用して、説明タイプのいくつかを説明しています。

- ユーザーのメリット

- 社会的容認

- 規制およびコンプライアンス

- システム開発

- 所有者のメリット

説明可能なAIはなぜ重要なのですか?

説明可能なAIは、自動化されたシステムにおいて信頼を高め、勝ち取り、維持するための重要なコンポーネントです。信頼がなければ、AI、特にAI for IT Operations(AIOps)は、完全に受け入れられず、近代システムの規模と複雑性が広がり、手動操作と従来の自動化で達成できることでは手に負えなくなるでしょう。

信頼が確立されると、AIの役割が希薄であったり、欠如している場合に、製品またはサービスがAIドリブンだとする「AIウォッシング」の実践が明白となり、実践者とお客様のいずれのAIデューデリジェンスも支援することができます。AIに対する信頼と信用を確立することは、その導入の範囲とスピードに影響を与えます。その後、いかに迅速かつ広く、そのメリットを実現できるかが決まります。

特に、現実世界に影響のあるシステムに答えを見つけさせたり、決断を下させたりする場合、システムがどのようにして決断にいたるのか、それが結果にどのように影響するか、または行動が必要と判断されたのかを説明することが不可欠です。

説明可能なAIのメリット

説明可能なAIの 利点は、多方向にわたります。情報に基づいた意思決定、リスク削減、信頼性とユーザーによる導入の高まり、より良いガバナンス、より迅速なシステム改善、および世界のAIの全体的な進化と実用性に関連します。

説明可能なAIが解決する問題とは?

多くのAIモデルとMLモデルは不透明であり、そこから導き出される出力は説明不可能なものです。なぜ特定の道筋をたどり、または、出力がどのように生成されたのかを明らかにし説明する能力は、AIの信頼性、進化、導入にとって極めて重要です。

データ、モデル、およびプロセスに光を当てることで、事業者とユーザーは、透明性のある有効な理論をもって、これらのシステムに対するインサイトと可観測性を得て、最適化を図ることができます。最も重要なことは、説明可能性により、欠陥、偏見、およびリスクがより容易に明らかにされ、その後軽減したり削除できるようになります。

説明可能なAIが透明性を形成し、信頼性を構築する方法

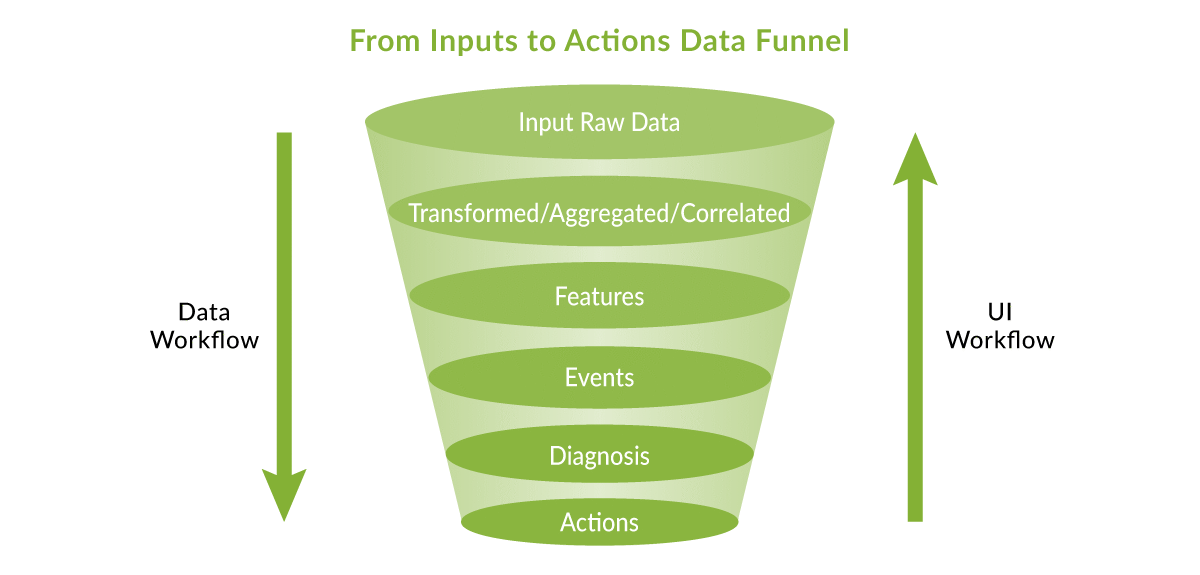

有用であるためには、初期の生データが、最終的に推奨動作または実行動作をもたらす必要があります。ユーザーに、最初から完全に自律的なワークフローを信頼するように求めることは、多くの場合突飛なことでしょうから、ユーザーが下位の証拠となる層から順に上へと進められるようにすることをお勧めします。イベントを層ごとに掘り下げて調査することで、ユーザーインターフェイス(UI)のワークフローから、生データが入力される部分にまで層を降りていくことができます。これにより、透明性と信頼性が促進されます。

分野の専門家がより深く掘り下げることで自らの懐疑心を満足でき、同時に、初心者が好奇心の赴くまま探索できるようにするフレームワークは、初心者と熟練者の生産性と学習が高まるにつれ、信頼を確立してくれます。これはまた、継続的なシステム改善に向けてAI/MLアルゴリズムをさらに鍛錬し磨き上げることができる好循環を生み出します。

AIドリブンのユーザーインターフェイスにおけるデータフロー

説明可能なAIを使用してリスクを評価し削減する方法

十分に定義されたプロトコルとデータ構造を備えるデータネットワーキングとは、AIが差別や人間の偏見を恐れずに驚くような進歩を遂げることができることを意味します。トラブルシューティングやサービスアシュアランスのような中立的な問題がある場合、AIの適用に明確な制限が定められ、責任を持って受け入れられます。

ベンダーが基本的な技術的および運用上の質問への回答を用意していることは重要で、AIウォッシングを暴露し避けるのに役立ちます。デューデリジェンスや調達への取り組みと同様、回答の詳細度から重要な知見を得ることができます。回答にはある程度の技術的な解釈が必要となるかもしれませんが、ベンダーの主張が実行可能であることを確認するために推奨されます。

他のテクノロジーと同様に、エンジニアリングおよび上層部は、提案された購入を評価する基準を設定し、関連する は証拠に基づいたものにします。リスクを削減し、デューデリジェンスを支援するため、AI/ML所有者とユーザーがたずねるべき質問例をいくつか挙げます。

- どのアルゴリズムがソリューションを構成し、それに貢献しているのか。

- どのデータが取り込まれ、どのように消去されのか。

- データはどこから来ているのか(テナント、アカウント、またはユーザーごとにカスタマイズされているのか)。

- ネットワーク空間からどのようにパラメータと機能を設計しているのか。

- モデルのトレーニング方法と再トレーニング方法、および新しさと関連性を維持する方法。

- システム自体が、推論、推奨事項、またはアクションを説明できるか。

- 偏見がどのように排除または削減されるのか。

- ソリューションまたはプラットフォームはどのように改善され、自動的に進化するのか。

また、AIサービスやシステムについての保証や主張を検証するため、パイロット版やトライアル版を常に推奨しています。

ジュニパーで実際に使用している説明可能なAI

AIを責任をもって倫理的に使用することは、複雑な課題ですが、組織が対応しなければならない課題です。Juniper Mist AIの革新原則では、ジュニパーのサービスおよび製品でのAIの使用について説明しています。また、AI/MLと当社のAIOpsアプローチについては、AIデータとプリミティブ、AIドリブンによる問題解決、インターフェイス、およびインテリジェントチャットボットなど幅広いトピックに関するドキュメントがあり、これらはすべて、より優れたツールを使用して運用を改善しながら、ネットワークの異常を検出し、修正するのに役立ちます。

XAIにはさまざまな形式があります。例えばJuniper AIOps機能には、Wi-FiネットワークでRRM(自動無線リソース管理)を実行し、ネットワークケーブルの不良などの問題を検出することができます。ジュニパーXAIツールのいくつかは、Mist製品インターフェイスから利用できます。ジュニパーのセルフサービスツアーにもデモがありますのでご覧ください。ここにご登録の上、今すぐアクセスしてください。

ユーザーと運用担当者の観点から、Mist AI™エンジンと仮想ネットワークアシスタント「Marvis」をベースにした製品内のさまざまな新機能にご期待ください。これらの機能は方法、モデル、決定、信頼性レベルの説明可能性をを高めるものであり、信頼性と透明性を向上させます。

説明可能なAIのよくある質問

説明可能なAIは何を意味しますか?

説明可能なAIは、AI/MLアルゴリズムによって作成された結果と出力をユーザーが理解し、信頼できるようにする一連のプロセスと方法です。AI/ML出力に 説明は、ユーザー、事業者、または開発者に向けたもので、ユーザーによる導入からガバナンス、システム開発にいたるまでの懸念事項や課題に対処することを意図したものです。

説明可能なAIモデルとは何ですか?

説明可能なAIモデルとは、透明性、理解の容易性、AI出力に対する質問やクエリが可能な機能を備えた特性またはプロパティのことです。

説明可能なAIはなぜ重要なのですか?

説明可能なAIはAIシステムの出力の根拠を詳細に説明し、AIシステムを導入し、その出力と結果を信頼するために人々が必要とする理解、ガバナンス、信頼性を提供します。XAIによって信用と信頼が構築されなかった場合、人々がこの技術を広く導入してメリットを受ける可能性が低くなります。

説明可能なAIにはどのような がありますか?

説明可能なAIには多くのメリットがあります。情報に基づいた意思決定、リスク削減、AIへの信頼性とユーザーによる導入の高まり、より良いガバナンス、より迅速なシステム改善、および世界のAIの全体的な進化と有用性に関連します。

説明可能なAIは存在しますか?

はい。しかしながらまだまだ定義が進化しているため、初期段階といえます。多数の機能またはフェーズを持つ複雑な混合AI/MLモデルにXAIを実装するのはさらに困難ですが、XAIは、製品とサービスに急速に進出しており、ユーザーとの信頼性を構築し、開発を早めています。

ディープラーニングにおける説明可能性とは何ですか?

ディープラーニングは「ブラックボックス」とみなされることもあります。これは、ディープラーニングモデルの困難なことがあるからです。説明可能性は、ディープラーニングをわかりやすく説明できるようにすることを目指しています。。深層学習モデルを説明するために使用される1つのテクニックは、Shapleyです。SHAP値は、予測に関与する機能を強調することで、特定の予測を説明できます。異なる説明方法の評価の研究が現在進んでいます。

ジュニパーはどんな説明可能なAI機能を提供していますか?

XAIにはさまざまな形式があります。例えばジュニパーでは、Wi-FiネットワークでRRM(自動無線リソース管理)を実行するか、ネットワークケーブルの不良を検出する複数のAIOps機能で使用されるMLアルゴリズムについて説明するブログとビデオを提供しています(下記のビデオリソースを参照)。MarvisのアプリケーションエクスペリエンスインサイトのダッシュボードはSHAP値を使用して、途切れるZoomビデオなどの、アプリケーションエクスペリエンスの低下を引き起こしているネットワーク条件(機能)を特定します。これらのXAIツールのいくつかは、Mist製品のインターフェイスから利用できます。ジュニパーのセルフサービスツアーにデモもありますので、ご覧ください。ここにご登録の上、今すぐアクセスしてください。